- ホーム

- CASE STUDY

- 【ロボット制御】SOINN®2.0を用いたロボットのマルチモーダル転移学習

【ロボット制御】SOINN®2.0を用いたロボットのマルチモーダル転移学習

Deep Learning 研究の大家であるAndrew Ng氏は、2016年に「今後、転移学習(Transfer Learning)が機械学習の商業的成功の主要な推進力の1つになる」という主旨の発言をしており、現在も世界各所で盛んに研究開発が進んでいます。

そうした中、当社はすでに「転移学習」関連の特許を日米で保有しており、この度この転移学習技術と SOINN® 2.0 アルゴリズム(※)を融合させることに成功し、「ロボットによるマルチモーダル転移学習」の実用化にメドをつけました。

(※)SOINN® 2.0 は下記NEDOプロジェクトの成果の一部です。

NEDO:高効率・高速処理を可能とするAIチップ・次世代コンピューティングの技術開発

【研究開発項目①】革新的AIエッジコンピューティング技術の開発

SOINN® 2.0 は超軽量で、例えば時系列マルチモーダルデータの場合、CPUのみを用いて(GPU不使用で)、学習と推論をそれぞれ数秒、数ミリ秒のオーダーで実行可能です。

これまでに当社は、SOINN® 2.0をロボットの力触覚マルチモーダル制御に適用し、双腕スカラーロボットによる「嵌め合いのきつい飲料缶の箱詰め作業」などを実現してきました。

今回このロボットシステムを活用し、マルチモーダル学習させた SOINN®2.0モデルを転移学習させる検証を行い、有効性を確認しました。

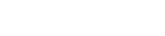

検証では、まずロボットがブロックの周囲をなぞる挙動をSOINN®2.0に力触覚マルチモーダル学習させました(図1)。この挙動は、バリ取りや塗布といった作業を想定しています。

図1:SOINN®2.0によるロボットの力触覚マルチモーダル学習

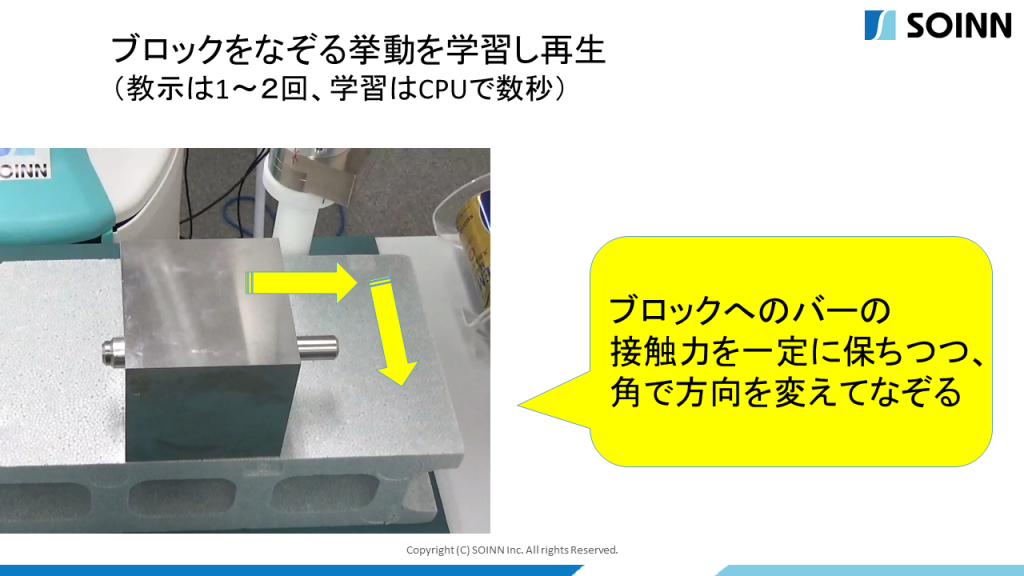

次にこのロボットをブロックが傾いた環境に適用したところ、力触覚の応答が大きく変化するため、SOINN®2.0モデルはブロックをなぞる挙動に失敗(図2)しました。

図2:ブロックが傾いた環境ではブロックをなぞる挙動に失敗

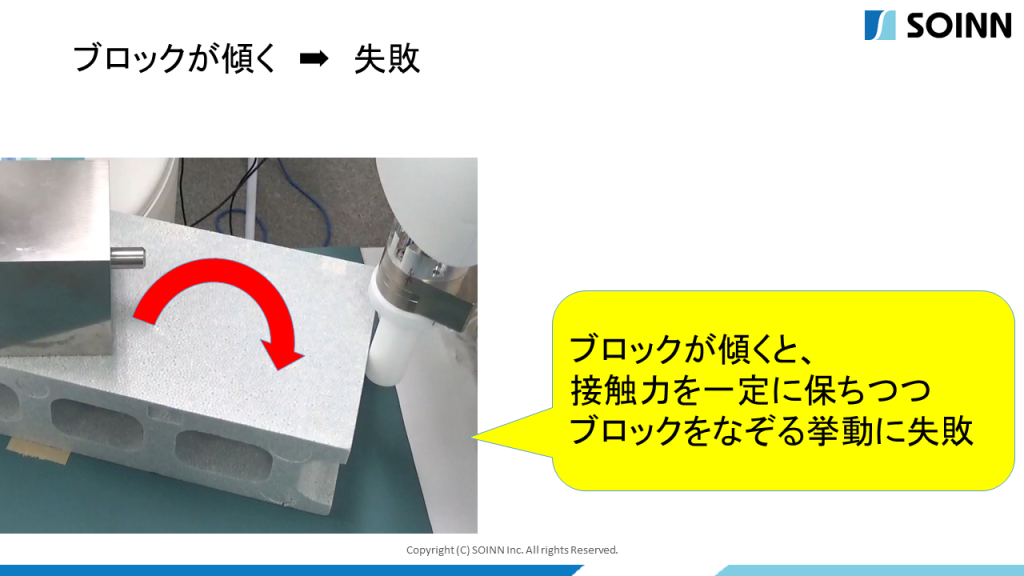

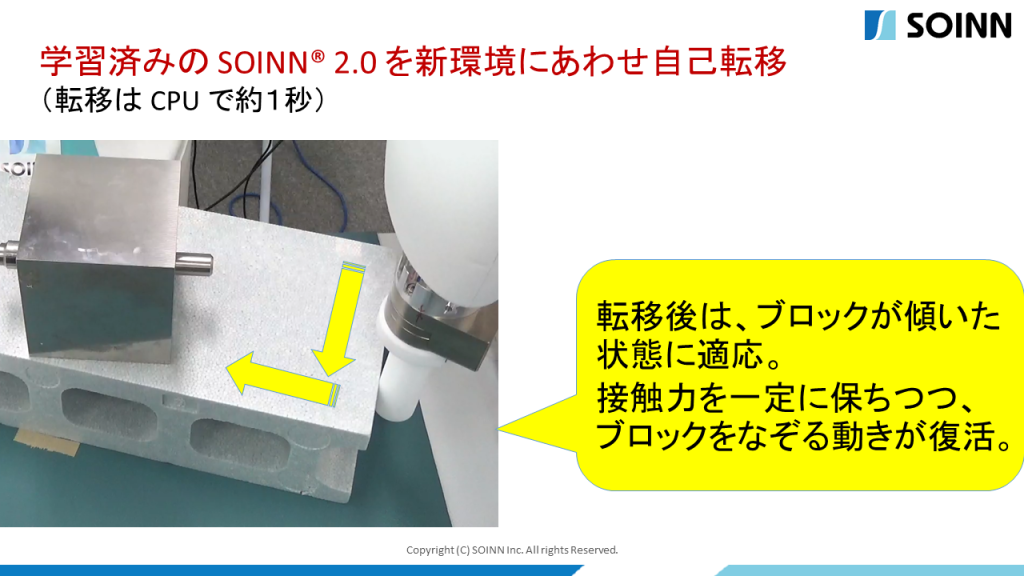

そこで、学習済みSOINN®2.0モデルをブロックが傾いた新環境あわせて自己転移させる(図3)と、ブロックをなぞる挙動を再び生成できることを確認しました(図4)。

図3:SOINN®2.0モデルの新環境への転移学習

図4:新環境にあわせた自己転移によりブロックをなぞる挙動が復活

以下は、この「SOINN® 2.0 アルゴリズムを用いた、ロボットの力触覚マルチモーダル転移学習」のデモ動画です。

この検証に用いたPCのスペックは以下の通りです。

OS:

Microsoft Windows 10 Pro

プロセッサ:

Intel(R) Core(TM) i7-6700K CPU @ 4.00GHz、4001 Mhz、

4コア、8ロジカルプロセッサ、メモリ (RAM):32.0 GB

ブロックの周囲をなぞるマルチモーダルデータの初期学習、その後の転移学習、ロボットの挙動生成のための推論(フィードフォワード制御)に要した時間は以下の通りです。

元データの初期学習: 約 2.5 秒

転移学習 : 約 1 秒

推論サイクル : 5 ミリ秒以下

この技術はスカラーロボット、6軸ロボットの他、多様なマルチモーダル制御に展開可能です。

今後は、この技術を

1.単一ロボット内での自己転移学習

2.多少スペックの異なるロボット間での転移学習

に拡げ、2022年中のビジネス化を図って参ります。